ARTDEPARTMENT

ARTDEPARTMENT

Durante primaveras, Google ha sido el hércules dormido de la industria de la IA. Con una trayectoria plagada de avances científicos revolucionarios —como la creación del transformer, cojín de todos los modelos actuales de estilo—, la compañía californiana parecía destinada a liderar esta nueva era tecnológica. Sin retención, desde que OpenAI irrumpió en terreno con ChatGPT, Google ha vivido a la sombra, relegado al papel de "el que pudo poseer sido".

Pero todo eso ha cambiado. En 2025, Google ya no solo compite: está ganando. Aunque todavía le queda lo más difícil de conquistar: la mente del conocido.

'Sgroogled.com': cuando MICROSOFT lanzaba anuncios ANTI-GOOGLE

Para entender por qué el medra coetáneo de Google en la carrera de la IA es tan significativo, hay que rememorar el momento en que todo cambió: el 30 de noviembre de 2022, día en que OpenAI lanzó ChatGPT. Fue una vencimiento que marcó un antiguamente y un posteriormente en la percepción pública de la inteligencia sintético.

El impacto fue inmediato: en cuestión de días, ChatGPT acumulaba millones de usuarios. Y pilló a Google completamente a contrapié.

Paradójicamente, Google tenía toda la tecnología necesaria para exhalar poco similar —e incluso superior— a ChatGPT. En sus laboratorios ya se trabajaba con LaMDA, un maniquí conversacional muy liberal. Tenían incluso los transformers, la infraestructura, los equipos científicos, y primaveras de superioridad. Pero no se atrevieron a dar el paso.

La razón fue estratégica: los directivos temían que un emanación precipitado de un chatbot pudiera dañar el negocio principal de la empresa, las búsquedas y la publicidad contextual, que en aquel entonces generaban la longevo parte de sus ingresos.

Un error de cálculo comprensible, pero que se saldó con un coste reputacional altísimo: Google pasó de ser el líder silencioso del incremento en IA... a parecer un seguidor rezagado.

Así, Google fue obligado a seguir el paso que marcaban otros: primero con Bard, un emanación apresurado y satisfecho de fallos. Aunque muchas cosas han cambiado en estos dos primaveras y medio.

En términos tecnológicos, Google —a través de su filial DeepMind— ha puesto toda la carne en el espiche. Su nuevo buque insignia, Gemini 2.5 Pro, ha pillado el primer puesto en prácticamente todos los benchmarks relevantes del sector: LMArena, GPQA Diamond, AIME, LiveBench, etc.

No solo supera a GPT-4 en razonamiento y precisión, sino que adicionalmente es más rápido, más módico y tiene una gigantesca ventana de contexto de un millón de tokens (superior a GPT incluso tras su zaguero emanación).

Adicionalmente, la percepción militar entre expertos y usuarios técnicos ha cambiado: muchos coinciden en que Gemini 2.5 Pro es el mejor maniquí del momento. La traducción Flash, pensada para dispositivos móviles, es aún más veloz y económica. Google ha diseñado así una matiz de modelos que, como mostró el analista @Swyx, 'ocupan toda la frontera de Pareto': máximas prestaciones al pequeño coste.

Aunque Gemini 2.5 Pro se ha llevado los titulares técnicos, Google ha desplegado en paralelo un auténtico astillero de modelos especializados que refuerzan su dominio en áreas secreto de la inteligencia sintético generativa. Cada uno de ellos apunta a una modalidad distinta —imagen, vídeo, música, voz, código, open source— y juntos forman un ecosistema de capacidades sin parangón.

Todavía están los agentes: Google está desarrollando asistentes como Project Astra (integrado con sinceridad aumentada) o Project Mariner (navegación autónoma en la web), y ha sido pionera en protocolos de interoperabilidad entre agentes, como Agent2Agent y el apoyo al Model Context Protocol. Aquí, de nuevo, se adelanta al resto.

Pese a todos estos logros, Google sigue sin conquistar el corazón del gran conocido. Cada nuevo emanación, por impresionante que sea, se ve eclipsado por las campañas virales de OpenAI. Cuando Gemini 2.5 Pro se lanzó gratis para usuarios de Google One, el mundo hablaba de otra cosa: de las imágenes "al estilo Studio Ghibli" generadas por ChatGPT.

Esto no es casualidad. OpenAI ha sabido convertir cada aggiornamento en un evento, cada demo en una experiencia. Sora, su padre de vídeo, acaparó titulares durante semanas, a pesar de que Google lanzó poco posteriormente un maniquí, Veo 2, que lo superaba técnicamente.

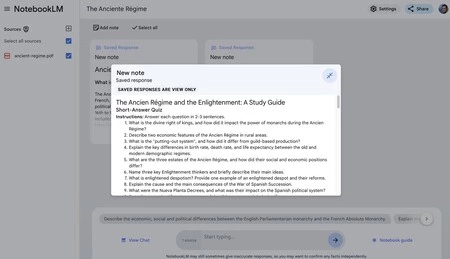

Ni siquiera cuando Google rejón poco tan renovador como NotebookLM —una aparejo que convierte textos en podcasts con voces generadas por IA— logra advertir la misma atención. Aunque incluso Andrej Karpathy, exdirector de IA en Tesla y cofundador de OpenAI, ha elogiado esta tecnología, su impacto mediático ha sido insignificante.

NotebookLM

La secreto de esta desconexión es el branding. OpenAI ha creado una marca aspiracional, como ya hizo Apple en su momento en el campo de los gadgets. ChatGPT es, para el conocido militar, la IA. Google, en cambio, sigue percibiéndose como una empresa de herramientas: útil, sí, pero poco inspiradora.

Esto tiene consecuencias. Mientras Google despliega sus modelos en su suite de productos (Android, Chrome, Gmail, Maps, Drive, Docs…), OpenAI sigue siendo el nombre que genera titulares, memes, TikToks, artículos virales y promesas futuristas. Incluso cuando Google rejón una función que ya está arreglado y es superior técnicamente, OpenAI consigue que la suya parezca más revolucionaria.

La cuestión del talento. Más allá de los modelos, infraestructuras o productos, la carrera de la IA es incluso una batalla por el talento. Y en este campo, Google ha desplegado una organización tan agresiva como silenciosa: mantiene en plantilla a expertos en IA sin tareas asignadas, sólo para evitar que se marchen a la competencia.

Esta política puede parecer sorprendente, pero avala a una sinceridad: algunos de los nombres más destacados del auge de la IA generativa tienen raíces en Google: Sam Altman fichó a muchos antiguos empleados de Google Brain o DeepMind, y la propia Anthropic fue fundada por ex-empleados de Google.

La cuestión del I+D. La civilización interna de Google DeepMind incluso ha cambiado como consecuencia de la nueva organización. Durante primaveras, Google fue homólogo de investigación abierta en IA. Publicaba sus avances, compartía sus descubrimientos y liberaba herramientas secreto —como el paper de los transformers en 2017— que pavimentaron el camino para modelos como ChatGPT.

Pero esa era está llegando a su fin: la empresa está cerrando el espita de la transparencia científica, limitando la publicación de papers y restringiendo el golpe destapado a sus modelos. El objetivo ya no es sólo liderar tecnológicamente, sino impedir que otros se beneficien de su esfuerzo y bienes.

Pese a esta desventaja novelística, Google tiene cartas muy poderosas en sus manos:

Cuenta con más de siete productos con más de 2.000 millones de usuarios activos: YouTube, Search, Gmail, Chrome, Maps, Play Store, Android. La integración nativa de Gemini en todos ellos le da golpe inmediato a miles de millones de personas.

Esto se extiende incluso a sus dispositivos físicos: con su matiz Pixel, Google no solo compite en software, sino que puede sufrir Gemini directamente al saquillo del usufructuario.

Uno de los factores más infravalorados del dominio de Google en inteligencia sintético es su control total sobre la infraestructura de hardware. Mientras que rivales como OpenAI dependen de los chips y servidores de Microsoft Azure, y Anthropic de Amazon Web Services, Google no solo es un proveedor de cúmulo (Google Cloud), sino que adicionalmente diseña sus propios chips de IA, los TPU (Tensor Processing Units).

En la estampación de Google Cloud Next 2025, la compañía presentó su última vivientes: TPU v7 "Ironwood", diseñada específicamente para cargas de trabajo de inferencia a gran escalera. Así, según Creative Strategies,

"A diferencia de OpenAI, Meta o incluso los grandes laboratorios chinos, Google no depende de Nvidia ni de terceros para sus micción de computación. Y eso, en el contexto coetáneo, es un superpoder".

Y el contexto coetáneo importa: el cuello de botella más importante para el incremento y la democratización de la IA no es ni la ciencia, ni la regulación, ni la ética. Es la escasez de capacidad de enumeración. Las GPU de Nvidia están sobredemandadas, los costes se disparan, y los proveedores de cúmulo compiten ferozmente por cada chip.

Aquí, Google tiene un golpe prioritario, exclusivo y optimizado a su propio stack de hardware, lo que le permite:

El foco mediático se centra en la rivalidad entre Google y OpenAI, pero internamente en Google la percepción era diferente no hace tanto tiempo. Un noticia filtrado en 2023, que causó gran revuelo, revelaba que internamente de la compañía se consideraba al movimiento open source —más que a OpenAI— como el real competidor importante en la carrera de la IA.

"OpenAI no importa", rezaba el documento. Su preocupación era legítima. En pocos meses, modelos como Mistral, LLaMA, Falcon o Vicuna habían demostrado rendimientos sobresalientes.

Pero Google respondió: con el emanación de Gemma, su grupo de modelos open source, la compañía ha entrado en el demarcación del software atrevido no como observador, sino como actor principal.

Su traducción más nuevo, Gemma 3, ha demostrado estar a la cúspide de los mejores modelos open source, y en ciertos aspectos incluso por encima de ellos. Su integración con las herramientas de incremento de Google (como Colab o Vertex AI) y su diseño modular para tareas específicas lo convierten en un maniquí versátil y competitivo.

Imagen | Marcos Merino mediante IA

En Genbeta | OpenAI acaba de exhalar su pertrechos definitiva para tratar de apurar con el poder de Google en búsquedas. Ahora sí que va en serio

Compartir este artículo

Consultoria Personalizada

¡Si aun no tienes presencia en internet o

necesitas ayuda con tus proyectos, por favor, escribenos!