ARTDEPARTMENT

ARTDEPARTMENT

La era de la inteligencia industrial generativa nos ha traído herramientas asombrosas, pero además un desafío mayúsculo: la desinformación. Aunque nuestra exposición constante a imágenes creada por IA nos ha hecho más escépticos, un reciente estudio de Microsoft demuestra que todavía somos muy fáciles de engañar. Y para probarlo, han emprendedor un test online que te dejará comprobarlo.

El estudio, que analizó las respuestas de 12.500 participantes frente a 287.000 imágenes, concluyó que los humanos tenemos una tasa de tiento de al punto que el 63% a la hora de diferenciar una foto verdadero de una sintética. Poco que puede afectar directamente a lo que vemos en las redes sociales, donde hay multitud de imágenes y vídeos que a veces podemos dudar si es IA o efectividad. Y es que no somos perfectos cuando el resultado de la IA ha sido muy rematado.

'Sgroogled.com': cuando MICROSOFT lanzaba anuncios ANTI-GOOGLE

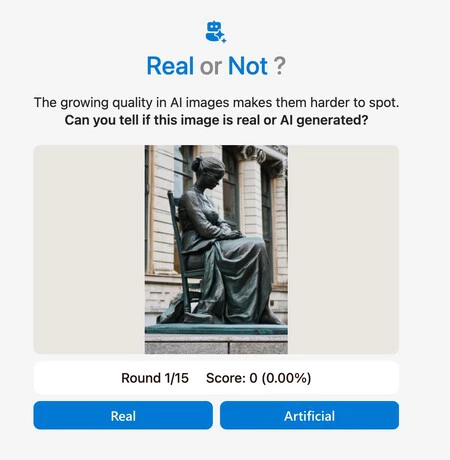

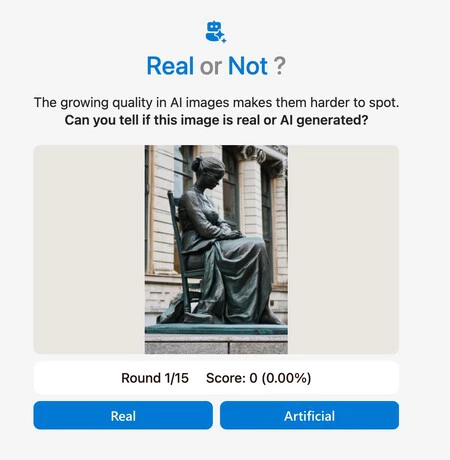

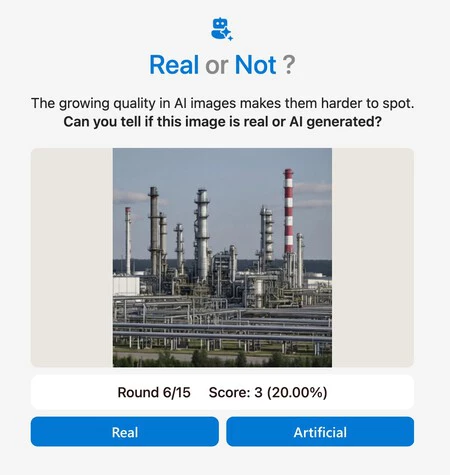

Y seguramente alguna vez has dicho "yo sí sé diferenciar correctamente una imagen hecha con IA". Pues ahora puedes demostrarlo. Microsoft ha creado el Real or Not Quiz, un test rápido donde se presentan 15 imágenes aleatorias. Algunas son de bancos de imágenes de stock, otras son creaciones con modelos como Midjourney o DALL-E. El objetivo es simple: osar si son reales o no.

Personalmente, tras poseer hecho varios intentos con este Quiz, he descubierto lo difícil que puede ser diferenciar algunas imágenes hechas con IA de la efectividad por lo correctamente hechas que están. Y es que cuando pensamos en IA nos puede venir a la mente la típica imagen qeu tiene un estilo cartoon, pero cuando se usa un buen prompt en una buena IA el resultado es muy diferente.

Y como yo, los resultados del estudio a gran escalera que realizó Microsoft muestra que nos equivocamos mucho. Como consideraciones, los humanos somos levemente mejores a la hora de identificar retratos falsos con una tasa de tiento del 65%. Pero si hablamos de los deepfakes creados con la tecnología GAN, se engaña al 55% de los participantes.

Pero cuando las imágenes no contienen a seres humanos, como por ejemplo en paisajes, nuestra precisión devaluación harto y es más posible que podamos proponer que una imagen es completamente verdadero cuando ha sido generada con IA.

Irónicamente, una de las razones por la que los deepfakes GAN siguen funcionando tan correctamente es porque su estética se asemeja a la de una fotografía de devaluación calidad, con menos detalles que los modelos de IA suelen sentenciar en replicar. Nos hemos acostumbrado tanto a la estética hiperrealista y pulida de las IA modernas que, cuando poco parece una foto insípido, nuestro cerebro tiende a verlo como poco completamente verdadero.

El estudio además destaca cómo los creadores de imágenes están afinando sus prompts para conseguir un viejo realismo. Algunas técnicas incluyen:

Pero lo más fascinante de este estudio, es ver como las imágenes que más confundieron a todos los que participaron eran completamente reales. Las tres imágenes con una tasa de identificación más devaluación eran imágenes auténticas. Y todas con tasas de tiento en realidad bajas del 12, 14 y 18%.

¿Qué tienen en global todas estas imágenes? Todas muestras al ejército estadounidense en escenarios inusuales, con condición de iluminación, saturación de color y velocidad de obturación atípicas. Esto sugiere que nuestro cerebro tiene un sesgo alrededor de lo que considera 'frecuente' en la fotografía. Cuando una imagen se sale de ese 'canon' que tenemos en nuestra mente es más probable que digamos que es completamente falsa.

Y esto es poco crucial. Entender qué tipo de imágenes y prompts son más efectivos para engañar al ojo humano es relevante para poder crear herramientas que persigan la desinformación. Y es que a medida que estas técnicas se van perfeccionando, los humanos vamos a poder ser persuadidos por información completamente errónea y cambiar nuestro pensamiento.

Por ello, la compañía insiste en que este estudio es un recordatorio de la importancia crítica de etiquetar de forma clara y transparente todo el contenido generado por inteligencia industrial. La confín entre lo verdadero y lo sintético se difumina, y la falta de herramientas de demostración es más urgente que nunca.

Imágenes |

En Genbeta | Cualquiera ha podido entrar a tus conversaciones con ChatGPT a través de Google, pero solo si las tenías 'públicas'

Compartir este artículo

Consultoria Personalizada

¡Si aun no tienes presencia en internet o

necesitas ayuda con tus proyectos, por favor, escribenos!