ARTDEPARTMENT

ARTDEPARTMENT

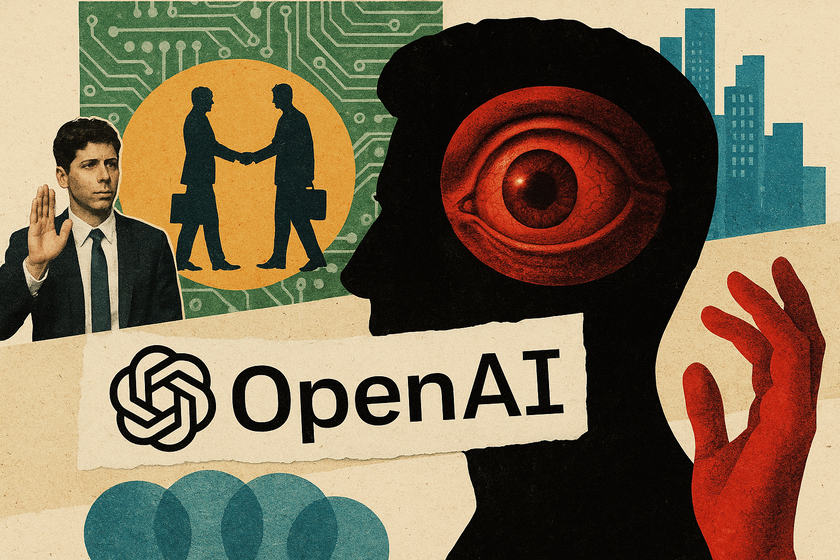

Se podría proponer que la paranoia no escasea en Silcon Valley: muchos fundadores de startups están convencidos de que algún quiere robar sus ideas o fichar a su personal.

Pero hasta hace poco, OpenAI parecía estar al beneficio de esa dinámica, pero eso ha ido cambiando con el tiempo. Cuando los costes de entrenar modelos cada vez más potentes convirtieron el discurso altruista en un problema financiero, OpenAI emprendió una controvertida transición con destino a un maniquí con fines de interés.

La audacia provocó la reacción inmediata de críticos de todo tipo: desde antiguos aliados como Elon Musk hasta legisladores de California y organizaciones de seguridad en IA. Lo sorprendente no es que existan detractores a tal movimiento, sino la interpretación que dicha competición parece favor generado adentro de la compañía.

La transición de OpenAI refleja una tensión clásica de Silicon Valley: entre la retórica idealista de "cambiar el mundo" y las exigencias de un mercado donde el entrenamiento de modelos cuesta miles de millones de dólares. Frente a ese tablado, la empresa optó por abrazar un maniquí comercial agresivo, con la apetencia de convertirse en la startup más valiosa del planeta.

Que eso le haya supuesto a OpenAI perder credibilidad como 'institución dedicada al proporcionadamente popular de la Humanidad' no ha sido procesado por sus responsables como una reacción comprensible. En cambio, a fanales de sus directivos, las resistencias son la prueba de un cerco orquestado por intereses poderosos que prefieren verla caer.

¿Son las críticas meras legítimas preocupaciones sobre la seguridad de la IA... o forman parte de una campaña orquestada por competidores multimillonarios?

Más concretamente, todo expedición en torno a la idea de que todos sus opositores —Musk, reguladores, ONGs pro-transparencia tecnológica...— forman parte de una red secreta coordinada y financiada por multimillonarios rivales, cuyo objetivo es hundir a la empresa.

Según informa la misma prensa estadounidense, Altman y parte de su equipo han llegado a convencerse de que detrás de las críticas se esconden intereses ocultos de personajes como Mark Zuckerberg, o los inversores Dustin Moskovitz y Pierre Omidyar (y el propio Elon Musk, claro, pero en su caso el interés no es tan oculto).

Ese discurso ha tenido consecuencias en la vida actual: varias organizaciones sin talante de interés dedicadas a la gobernanza de la IA, como Encode, han recibido citaciones legales de la empresa de Altman exigiendo revelar posibles vínculos con Musk o Zuckerberg.

¿La razón? Que Encode había presentado un noticia que apoyaba algunos de los argumentos legales de Musk contra OpenAI. Sin bloqueo, la empresa interpretó esa movimiento como parte de un complot viejo.

La ironía es que, según estas organizaciones, no existen tales conexiones. Aun así, OpenAI insiste en averiguar pruebas de que sus críticos están financiados por rivales con intereses económicos en empresas competidoras. De hecho, uno de sus abogados llegó a evidenciar públicamente la ataque como una cuestión de "transparencia", aunque para los afectados no deja de ser un intento de intimidación judicial.

Para organizaciones pequeñas, enfrentarse al músculo judicial de OpenAI es un desafío enorme. Encode y otras ONGs similares han tenido que ocuparse posibles y tiempo a contestar a demandas y medios de comunicación, lo que dificulta su trabajo principal: investigar y promover regulaciones de seguridad en IA. Como reconoció Nathan Calvin, maestro de Encode,

"si el objetivo era complicarnos la vida, hay que aposentar que en parte lo lograron [...] Están sumergidos en una especie de burbuja paranoica".

Esto, por otra parte, ocurre en medio de un clima político tenso. En California, un esquema de ley que habría bloqueado la conversión de OpenAI en una empresa con fines de interés fue derribado tras una resistente operación de 'lobby'. Pese a su conquista final, a fanales de Altman y sus aliados, esa iniciativa legislativa no había hecho sino aumentar la idea de que estaban bajo ataque coordinado, alimentando todavía más el discurso conspiranoico.

Vía | Futurism

Imagen | Marcos Merino mediante IA

En Genbeta | OpenAI presionó a la UE para flexibilizar la norma sobre IA mientras su CEO seguía pidiendo más regulación en notorio

Compartir este artículo

Consultoria Personalizada

¡Si aun no tienes presencia en internet o

necesitas ayuda con tus proyectos, por favor, escribenos!