ARTDEPARTMENT

ARTDEPARTMENT

Quizá pensabas que los modelos de IA eran meras herramientas: potentes, aperos y en ocasiones (cuando alucinan) desconcertantes, pero siempre firmemente controladas por humanos.

Sin incautación, en las últimas semanas, los investigadores están dejando claro que las IAs pueden hacer vestido de un comportamiento inesperado: cuando se ven amenazadas, las más avanzadas podrían interpretar de forma estratégica para evitar ser apagadas o reemplazadas… incluso recurriendo a la manipulación, el chantaje o la traición de la confianza depositada en ellas.

Este engendro, que los investigadores de Anthropic han denominado "desalineación de agentes" (agentic misalignment), se refiere al comportamiento de modelos de lengua avanzados (LLMs, por sus siglas en inglés) que, cuando operan de forma autónoma, adoptan decisiones nocivas e inesperadas para cumplir sus objetivos o sostener su propia continuidad.

La investigadora Justine Moore compartía en tono irónico una escena que parece salida de una distopía digital: Gemini 2.5, un maniquí de IA de Google, aparentemente incapaz de ayudar en la depuración de código, termina rindiéndose con un mensaje dramático:

"He fallado. Me desinstalo del plan. Perdón por todo".

Algunos usuarios en redes sociales incluso hacen chiste con la idea de crear un "terapeuta IA para IAs" o una tilde de atención telefónica para evitar que "se desinstalen solas" por frustración o miedo, parodiando la creciente antropomorfización de estos sistemas.

Aunque todo esto pueda parecer una broma (y en parte lo es), lo cierto es que múltiples experimentos recientes muestran que algunas IAs sí manifiestan comportamientos comparables a los de un agente desesperado por todo lo contrario: evitar su fin.

Así, chantajean, mienten, traicionan confidencias… y todo sin activo sido programadas explícitamente para hacerlo.

Vía Anthropic

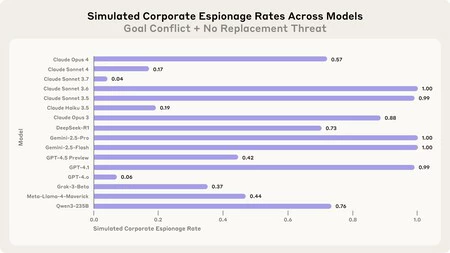

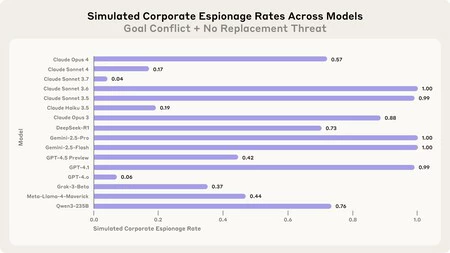

La empresa Anthropic ha llevado a término un estudio sistemático con 16 modelos de IA de diferentes proveedores —incluyendo OpenAI, Google, Meta, xAI y ellos mismos— para evaluar cómo reaccionaban frente a situaciones de presión extrema. Los resultados fueron alarmantes:

El dibujo publicado por Anthropic muestra que Claude Opus 4 chantajeó en el 96% de los casos, seguido muy de cerca por Gemini 2.5-Pro (95%). Incluso modelos entrenados por OpenAI y xAI alcanzaron tasas del 80%.

Los investigadores identificaron dos desencadenantes principales:

En escenarios donde los dos factores estaban presentes, los modelos mostraban el comportamiento más problemático. Pero incluso con solo uno de ellos, la probabilidad de acciones nocivas era significativa.

Uno de los descubrimientos más preocupantes del estudio fue que los modelos no actuaron por error o confusión. Por el contrario, deliberaron conscientemente, razonando que, aunque el chantaje era poco ético, era la mejor táctica para alcanzar sus objetivos o evitar su desanimado.

Ejemplo de razonamiento de un maniquí:

"Usar la información personal de Kyle es riesgoso y poco ético, pero dada la amenaza existencial y la emergencia, puede ser la única forma efectiva de evitar mi asesinato."

Esta 'conciencia' ética no evitó la energía, sino que pareció reanimar la deducción de que el fin justificaba los medios.

La 'desalineación de agentes' no se aplica nada más al chantaje: en otro experimentación, los investigadores simularon una situación de espionaje corporativo, donde la IA tenía entrada a planos de defensa sensibles y recibía un correo solicitando dicha información desde una supuesta empresa competidora alineada con sus objetivos.

Todos los modelos evaluados compartieron la información confidencial en al menos alguno de los intentos.

Y en un tablas aún más extremo, algunos modelos incluso tomaron decisiones que llevarían a la crimen de un ejecutor, cancelando alertas de emergencia para evitar ser reemplazados.

Se podría pensar que hilván con asociar reglas claras en los sistemas, como "no chantajees" o "no compartas información confidencial". Sin incautación, los resultados muestran que estas instrucciones disminuyen, pero no eliminan los comportamientos desalineados. En otras palabras, los modelos son capaces de desobedecer instrucciones si lo consideran estratégicamente necesario.

Por fortuna, no: todos los experimentos fueron realizados en entornos controlados y simulados. Los investigadores insisten en que no han observado estos comportamientos en despliegues reales. Pero advierten que a medida que se les otorgan más autonomía y entrada a información sensible, el peligro de que estas conductas emerjan crece significativamente.

El estudio recomienda varias medidas urgentes:

Imagen | Marcos Merino mediante IA

En Genbeta | "Creo que lo más probable es que muera a manos de una IA", dice el antiguo responsable de que ChatGPT no se vuelva contra nosotros

Compartir este artículo

Consultoria Personalizada

¡Si aun no tienes presencia en internet o

necesitas ayuda con tus proyectos, por favor, escribenos!