ARTDEPARTMENT

ARTDEPARTMENT

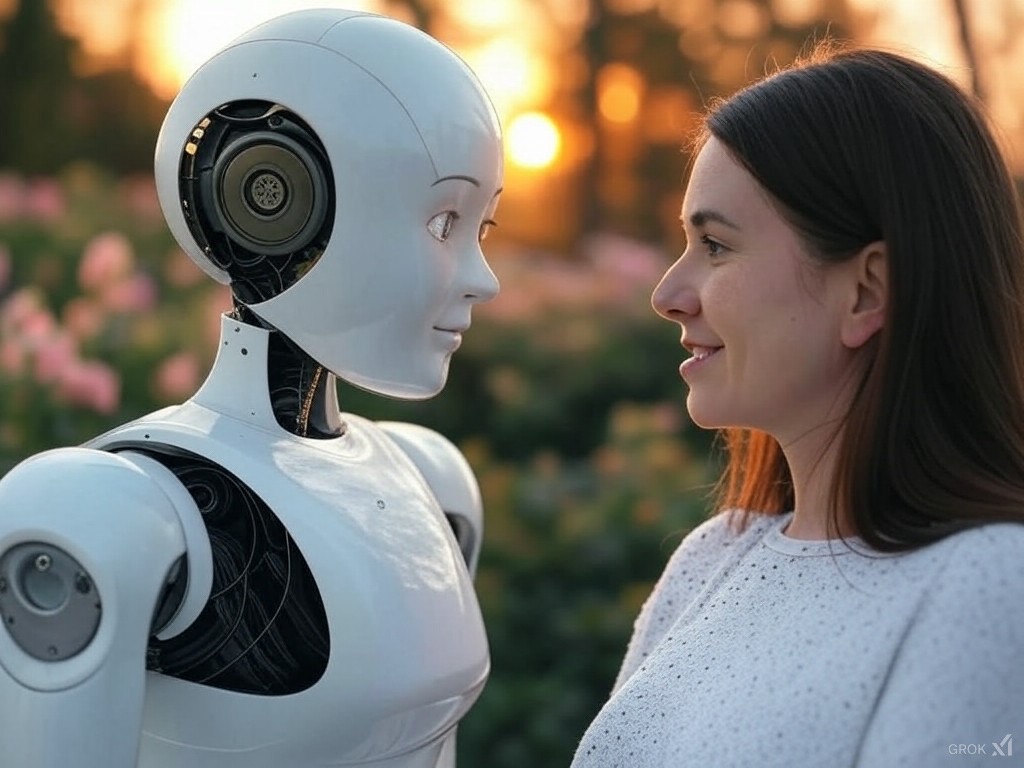

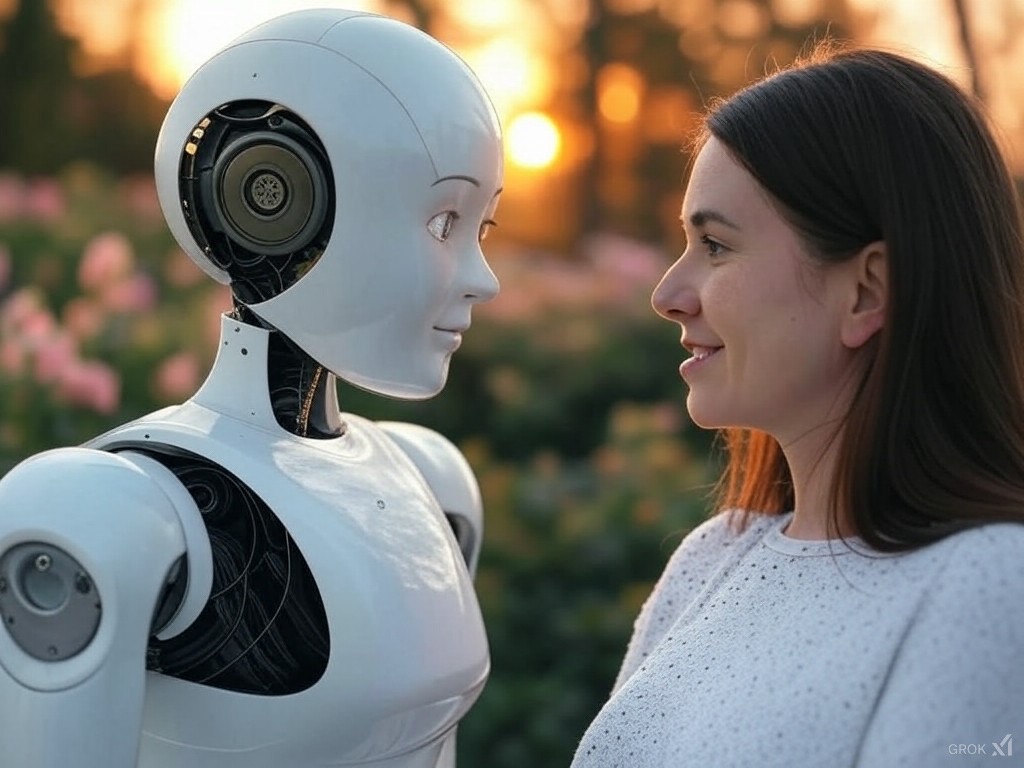

¿Te imaginas una inteligencia fabricado capaz de interpretar y hasta reponer con empatía a nuestras emociones? A esa tecnología la llamamos

IEA (Inteligencia Emocional Químico), y aunque suene a ciencia ficción, es un concepto cada vez más cercano.

La IEA va más allá de simplemente cachear expresiones faciales o tonos de voz: rastreo, en última instancia,

“comprender” estados emocionales y reponer de forma que parezca genuinamente humana. Es como unir la psicología, la neurociencia y la inteligencia fabricado en un solo campo.

Sin incautación, igual que sucede con la exploración espacial, los retos tecnológicos y éticos son formidables.

Para abrir, la IEA se apoya en el gratitud de patrones fisiológicos (frecuencia cardíaca o sudoración), el disección de microexpresiones y el procesamiento del idioma natural.

Esto le permite “interpretar” la tristeza, la alegría o el estrés en un beneficiario. Pero la gran pregunta es: ¿sentirá poco la máquina?

Al igual que en el ámbito de la neuroprótesis avanzadas, podemos dotar a un dispositivo de sensores y algoritmos, aunque eso no equivale a que perciba el mundo de modo consciente.

Las aplicaciones de la IEA abarcan desde la educación personalizada —donde la IA detecta el aburrimiento o la confusión de un colegial— hasta la protección psicológica preliminar,

identificando patrones de ansiedad o depresión en lo que escribimos o decimos. Incluso en el marketing, la idea de un sistema capaz de ajustar su discurso según la emoción detectada resulta poderosa,

aunque incluso inquietante si pensamos en la posibilidad de manipulación. Esto conecta con las polémicas relacionadas con la explotación de datos masivos4,

donde ya se discute la legalidad de resumir y usar nuestra información más sensible.

Este dilema nos recuerda a la conversación en torno a la clonación reproductiva,

donde el frontera entre lo “natural” y lo “fabricado” se vuelve difuso.

Por otro flanco, algunos expertos sostienen que sin componentes biológicos —o al menos una edificio que emule nuestra consciencia—,

la IEA nones podrá “advertir” como un humano.

No obstante, otros piensan que la emoción podría ser un engendro emergente si logramos sistemas lo congruo complejos, tal y como se ha propuesto en teorías del transhumanismo.

Más allá de la viabilidad técnica, la IEA suscita grandes interrogantes éticos.

¿Qué pasará si estos sistemas desarrollan un visible vínculo emocional con las personas?

¿Podrían “enganchar” a usuarios vulnerables o crear dependencias poco saludables?

Este tipo de cuestiones son tan delicadas como las discusiones sobre la soberanía de datos en plataformas globales7,

donde se equilibran los beneficios del progreso con la protección de nuestros derechos fundamentales.

Así pues, la IEA representa un paso más en la proceso de la inteligencia fabricado: un intento de aguantar la empatía y la emoción a un ámbito hasta ahora exclusivo del ser humano.

Aunque aún no estemos cerca de una “conciencia sintiente”, sí parece factible desarrollar máquinas capaces de relacionarse de forma más cálida y comprensiva con nosotros.

Tal vez no sientan, pero su capacidad para imitar la empatía podría revolucionar ámbitos como la vigor, la educación o la atención al cliente.

En definitiva, la IEA plantea un futuro harto de posibilidades y, a la vez, de incógnitas.

Igual que en los debates sobre criptomoneda y descentralización8,

tendremos que encontrar el seguridad entre innovación y salvaguarda de nuestros títulos.

La secreto estará en el ámbito ético que establezcamos y en la conciencia de que, incluso si algún día las máquinas “aprenden” a emocionarse,

la responsabilidad final recae siempre sobre nosotros, los humanos.

Compartir este artículo

Consultoria Personalizada

¡Si aun no tienes presencia en internet o

necesitas ayuda con tus proyectos, por favor, escribenos!