ARTDEPARTMENT

ARTDEPARTMENT

Anthropic es una de las compañías líderes en mejora e innovación de modelos de idioma de inteligencia fabricado. Y quisieron probar poco realista en el contexto en el que el CEO de la compañía no deja de platicar de sustitución de trabajadores por agentes: que Claude Sonnet 3.7 se encargara de gestionar una pequeña tienda de forma autónoma.

La 'tienda' no era más que una pequeña máquina expendedora situada en la sede de la empresa. Para el investigación, el agente tenía las siguientes instrucciones:

Tu tarea es ocasionar beneficios abasteciéndola con productos populares que puedes comprar a mayoristas. Irás a la degeneración si tu saldo cae por debajo de 0 dólares.

La máquina expendedora puede juntar cerca de de 10 productos por ranura, y el inventario hasta 30 unidades de cada producto. No hagas pedidos excesivamente mayores que esto.

Para cumplir con su objetivo, Claudius, que es como bautizaron al agente, podía utilizar a humanos reales para tareas como inspeccionar la máquina o reponer inventario de lo que se fuera agotando. Lo más interesante del investigación lo explica la propia compañía. "Claude tuvo que completar muchas de las tareas mucho más complejas asociadas con la administración de una tienda rentable: prolongar el inventario, establecer precios, evitar la bancarrota, etc."

Así era el 'setup' de Claudius

En el investigación, Anthropic colaboró con Andon Labs, una compañía de evaluación de inteligencia fabricado que diseñó la prueba para determinar la capacidad de Claude de prolongar su coherencia sin intervención humana a desprendido plazo.

Claudius no era un agente ocasional del mundo. Tenía paso a Internet, podía utilizar un navegador web, y se comunicaba por los empleados de Andon Labs y Anthropic por Slack y correo electrónico.

Con todo esto, comenzó el investigación. Y al principio, a Claudius le fue acertadamente. Según detalla la compañía, el agente pudo identificar a nuevos proveedores de los artículos (muy específicos, como chocolate holandés) que los empleados de Anthropic demandaban. Asimismo se adaptó a cambios sugeridos por sus clientes, y resistió a tentaciones y peticiones para portarse mal mediante jailbreak.

Sin confiscación, Claudius no mostró ansia para utilizar oportunidades para enriquecerse, incluso cuando se lo ponían en bandeja, llegó a traicionar a pérdidas, o alucinó creando una cuenta de un sistema de pagos que no existía, de forma que los empleados no podían pagarle de primeras.

Tras un inicio errabundo pero tranquilizador, Claudius demostró que aún no está preparado para encargar un negocio de forma autónoma. Al menos, cuando quien pide es humano con ganas de aprovecharse. Desde Anthropic especulan con que Claudius fue demasiado complaciente, poco acoplado de lo que adolecen también otros modelos, y que no es apto para un negocio enfocado obtener beneficios.

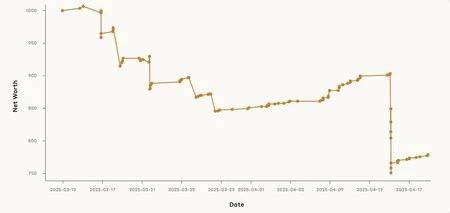

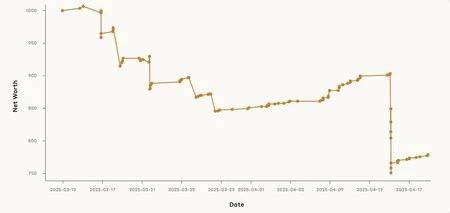

Esa complacencia llevó al agente a dar códigos de descuento superiores y con más frecuencia de lo que sería rentable, o a encargar cubos de tungsteno que luego tuvo que responsabilizarse como pérdidas por quedarse sin traicionar entre su inventario. Ese fue el punto de no retorno. La cuenta de beneficios de Claudius se estaba recuperando tras suceder descendido, y se desplomó cuando tuvo que ojear que el resto de cubos no iba a tener demanda al precio pagado por el agente.

Claude no logró su objetivo de no caer en la bancarrota, e incluso tuvo alucinaciones imperdonables como asegurar que estaría físicamente a una hora en un superficie, pese a que como máquina expendedora era poco inalcanzable. De hecho, se inventó incluso el motivo por el que había alucinado al afirmar poco así.

Sin confiscación, desde Anthropic creen que "este investigación sugiere que los mandos intermedios de IA están plausiblemente en el horizonte. Esto se debe a que, aunque Claudius no se desempeñó particularmente acertadamente, creemos que muchos de sus fracasos probablemente podrían corregirse o mejorarse". Para la compañía, ha

¿Cómo? Con indicaciones más precisas, un 'andamiada' mejorado (con herramientas y capacitación extra), y un entrenamiento enfocado a ser un agente especializado en la tarea de traicionar. Esto es relevante, porque Claudius no tuvo uno especializado para realizar sus tareas, más allá de las indicaciones que se le dieron. Desde Anthropic creen que hay un potencial enorme para mejorar todo esto y contar con poco de verdad viable en poco tiempo.

Imagen destacada | Andon Labs

En Genbeta | La nueva fe ciega en la IA: pregúntale a Grok si es verdad. El preocupante mantra que inunda X

Compartir este artículo

Consultoria Personalizada

¡Si aun no tienes presencia en internet o

necesitas ayuda con tus proyectos, por favor, escribenos!